本文尝试梳理AI算力爆发背景下,HVDC系统散热技术的革新路径,聚焦液冷协同与材料升级两大方向。内容源于行业公开资料整理,若有疏漏之处,恳请指正。

1- HVDC崛起与散热需求升级的必然性

AI算力爆发式增长显著提升了数据中心功率密度(单机柜超100kW),推动了对高效率供电系统的需求。传统UPS面临效率与占地挑战,而HVDC系统凭借其高效、低损耗、小体积和高可靠性优势,正迅速成为AI数据中心的主流供电方案。这直接驱动了HVDC市场的快速增长和在AI数据中心渗透率的飙升。同时,AI需求也促使HVDC技术向更高电压等级发展(如750V、1000V系统),以进一步提升效率和功率承载能力。

a.AI算力爆发与能效苛求

为满足高能效标准(如数据中心PUE≤1.5/≤1.3),HVDC散热技术需实现:

·高效冷却设计,采用液冷技术应对高功率密度;精确控制冷却参数。

·热传输介质优化,优先使用去离子水,特殊场景选用防相分离的稳定流体(如PCD)。

·散热器性能升级,采用高导热材料;特殊流道设计提升热交换效率。

·动态温控与监测,实时监控关键点温度;配备诊断设备预判故障。

·冗余与可靠性设计,如:冷却系统N+1冗余配置,双路冷冻水管网防单点故障。

·应急散热能力,支持极端工况散热。

·环境适应性,确保15-35℃环境温度下稳定运行,兼顾防潮通风。

b.第三代半导体(SiC/GaN)的应用深化

AI算力激增推动800V高压直流架构成为数据中心新趋势:

·SiC/GaN凭借 高功率密度、高频开关、低损耗 特性,逐步替代传统硅基器件。

·显著提升系统效率。

·降低材料成本并增强可靠性。

c.HVDC vs. AC供电的能效优势及其散热影响

HVDC架构对散热系统的要求主要体现在高功率密度、高效冷却方式、冗余设计、环境适应性、能效优化以及快速故障恢复等方面。这些要求共同决定了HVDC系统在设计和运行中的复杂性与挑战性。

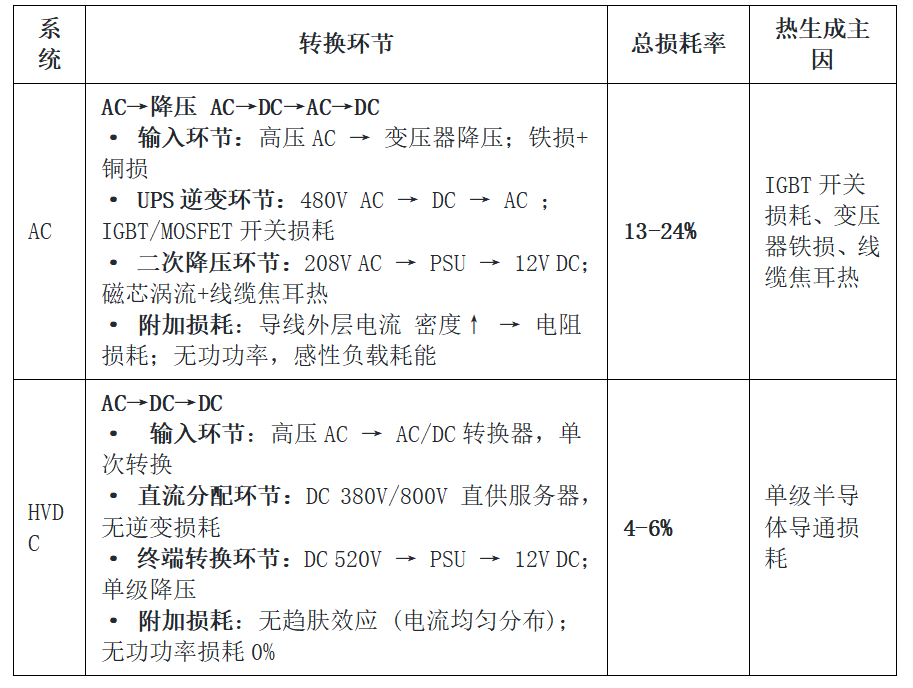

表1:HVDC vs AC 能量转换损耗的根源差异分解

2- 革新核心:液冷协同与材料升级的解决方案

a.液冷系统:从边缘到主流的代际跃迁

液冷渗透率从快速跃升,AI算力驱动GPU功耗达1000W倒逼风冷转型,边缘场景下沉需适应-30℃~60℃极端温域。

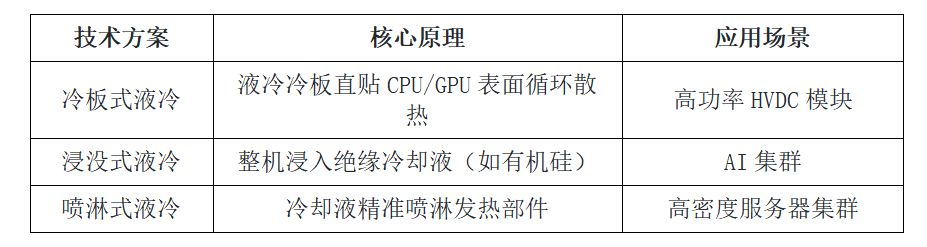

表2:技术路径的代际跃迁

b.材料升级:应对极限热挑战的关键突破

材料升级推动散热效能突破:通过高导热界面材料优化晶闸管热管理,结合氮化铝陶瓷基板(热导率≥180W/mK)强化SiC/GaN器件散热能力,并采用复合液冷结构支撑高功率密度。系统层面通过N+1冗余液冷架构、智能温控策略及800V耐压管路设计,实现安全高效的协同散热。

3-技术挑战与散热产业链机遇

a.关键挑战:标准化与兼容性瓶颈

芯片级冷板接口不统一与机柜级管路耐压差异(500V~800V)导致兼容性差,推高改造成本;冷板式与浸没式技术路线割裂,冷却液绝缘标准缺失加剧产业碎片化;运维环节存在漏液检测机制不足、冷却液性能衰减标准空白等隐患,根源在于芯片商/服务器商/液冷方案商三方生态割据,形成责任模糊的"孤岛化"困局。

b.协同机遇:技术协同与产业协同

芯片层推动冷板接口标准化,系统层通过AI温控算法联动HVDC负载与冷却流速;产业层依托ODCC建立接口与冷却液标准,以模块化整机缩短部署周期;创新冷却液再生技术及设备租赁模式降低成本,并通过保险机制覆盖漏液风险,实现技术-产业-金融三维协同。

当前HVDC散热技术仍面临标准化、兼容性等挑战,但产业协同已显现破局曙光。本文仅作阶段性观察,期待与业界同仁共同探讨优化方向。

我们会定期更新有关热设计与轻量化的技术与资讯,与您分享,供您参考,感谢您对迈泰的关注。